1997年,吴宇森执导、尼古拉斯·凯奇主演的电影《变脸》上映。影片中,用激光切割脸皮的镜头,如今想来还有点瘆人,但也成为全片最大的情节亮点。

20年后,吴宇森有两件事情没有想到:一是凯奇变成了“烂片之王”,二是换脸这件事,已经成为人们的娱乐。

ZAO脸热

9月的第一天,一款名叫“ZAO”的换脸软件突然在朋友圈燥了起来。

软件只需你上传一张面部清晰的照片,就能利用AI合成技术,将你的脸部换到明星脸上,生成电影视频或照片,网友们玩得不亦乐乎。

在这股娱乐风潮中,人们似乎还没意识到把“脸”给丢了。

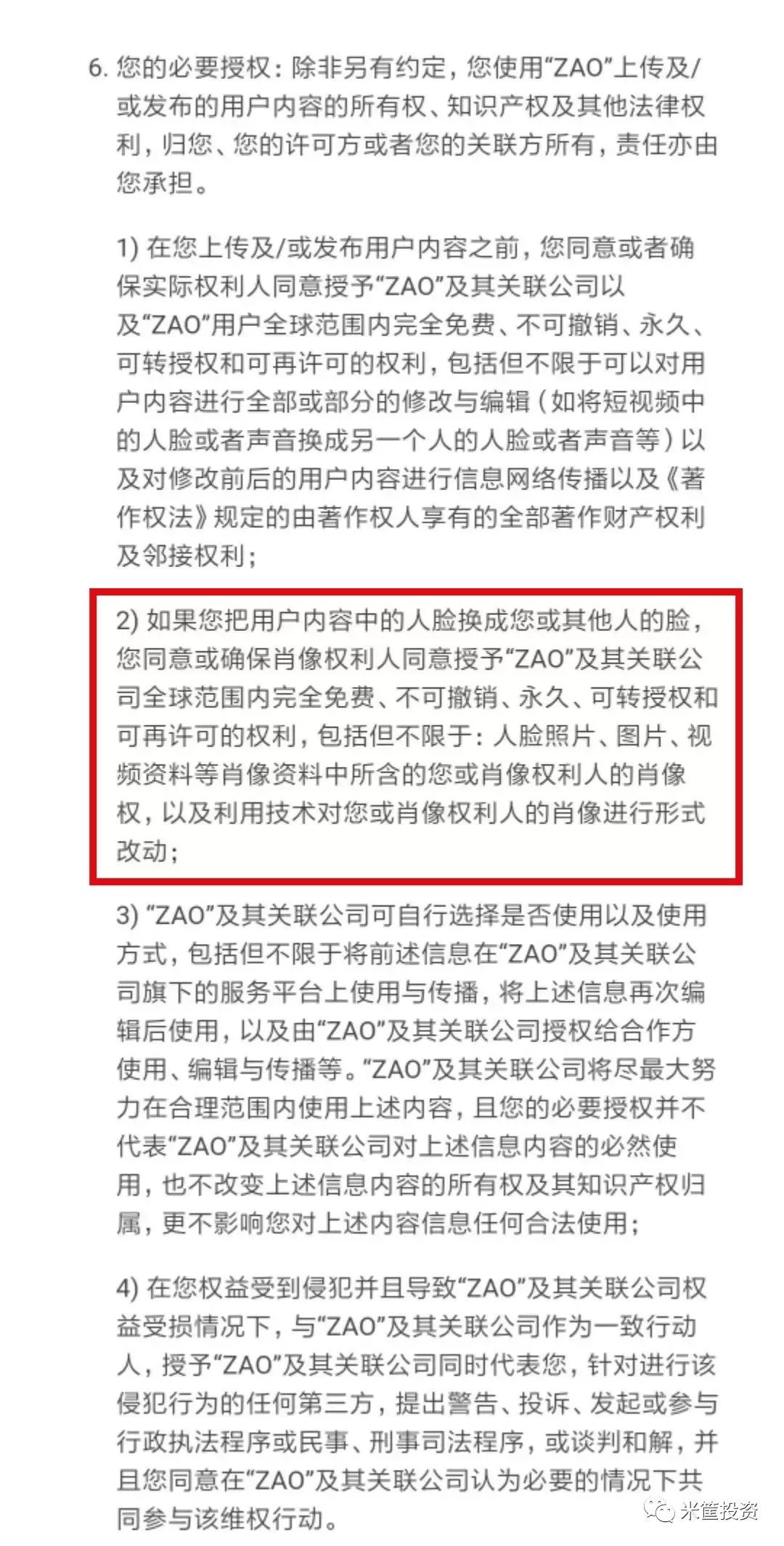

软件莫名走红的第二天,就有人扒出其用户协议中,有一条霸王条款:

尤其是第2点:

如果您把用户内容中的人脸换成您或其他人的脸,您同意或确保肖像项权利人同意授予“ZAO”及其关联公司全球范围内完全免费、不可撤销、永久、可转授权和可再许可的权利,包括但不限于:人脸照片、图片、视频资料等肖像资料中所含的您或肖像权利人的肖像权,以及利用技术对您或肖像权利人的肖像进行形式改动;

啥意思?当你在ZAO上传照片生成视频后,这一些列资料包括肖像权,该软件都有权免费使用,并进行修改编辑。

如今,手机解锁、购物支付、公共交通、上班打卡等都可以“刷脸”解决,如果自己的“脸”丢了,背后的隐私泄露风险,可想而知。

于是,网友愤怒了:这不是明显的霸王条款?还想把我的脸丢到全球?

这款陌陌旗下的软件也迅速给予了回应:不,我们没有采集任何个人生物识别特征,而且合成的图像不是用户真实信息。

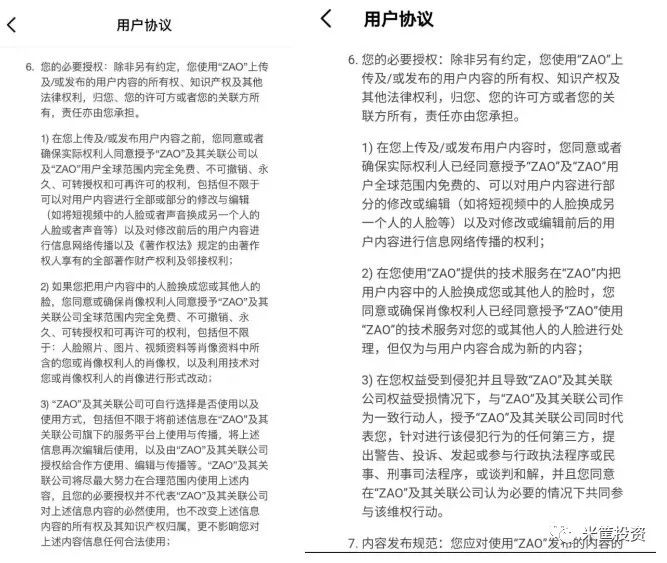

嘴上说着没有,但身体还是很诚实的。在回应的同时,他们顺便把用户协议改了:

△左图为修改前,右图为修改后

很明显,不可撤销、永久等字眼已经消失。在这之后,ZAO的热度也瞬间转凉。

屡换屡凉

换脸这件事上,凉了的不止ZAO一个。

早在2017年,AI换脸就出现了。在深度学习算法的基础上,一款叫做“Deepfake”的软件横空出世,与ZAO的运作原理一样,将照片AI合成至视频换脸。

Deepfake 一开始只在小范围内流行,网友们也只是给明星换换脸,娱乐一下而已。比如下面这个著名的小片段,把杨幂的脸换到了83版射雕英雄传的黄蓉脸上:

而推动它迅速火爆起来的,是把明星的脸换到不可描述的小电影上。有时候你得承认,人的本能需求,也是推动技术创新的动力之一。

但技术的进步,不能凌驾于道德至上。AI换脸在成人影片中的扩散,给女明星带来了阴影。不仅形象版权、名誉都受到伤害,在辟谣的难度上,也增加不少,因为你很难给那些不懂这项技术的人解释清楚,什么是AI换脸。

更有甚者,拿着换脸视频上门敲诈勒索,成了不稳定因素之一。

于是,Deepfake遭遇全球封杀。

今年出现的一款模仿应用Deepnude,俗称“一键脱衣”,推出几个小时服务器就被挤爆。但因其一面世就带着作恶的目的,面临的道德谴责压力更大,几天后创始人主动关停了这个项目。

技术的进步,带来的是隐私保护的难度提升。从指纹识别到人脸识别,甚至以后的眼球识别,人的生物体征信息,越来越成为关键隐私。一旦有信息泄露,对个人的生活都将会带来全方位的危机。

未来时代,“脸”一点都不能丢!

校园监视危机

巧合的是,这几天还有家公司因为人脸,登上了热搜。

8月25日,港交所公布了旷视科技的IPO信息。这家由三个清华大学生创立,以人工智能为标签的独角兽公司,成立8年时间里融资4轮12次,总融资金额达到13.49亿美元,估值也达到了40亿美元。

旷视科技的主营业务可概括为个人物联网、城市物联网和供应链物联网三大类。而其中的个人物联网业务,就是以人脸识别技术为核心展开的。

旷视旗下的Face++,人脸识别准确度高达97%,已广泛用于多家智能手机厂商。

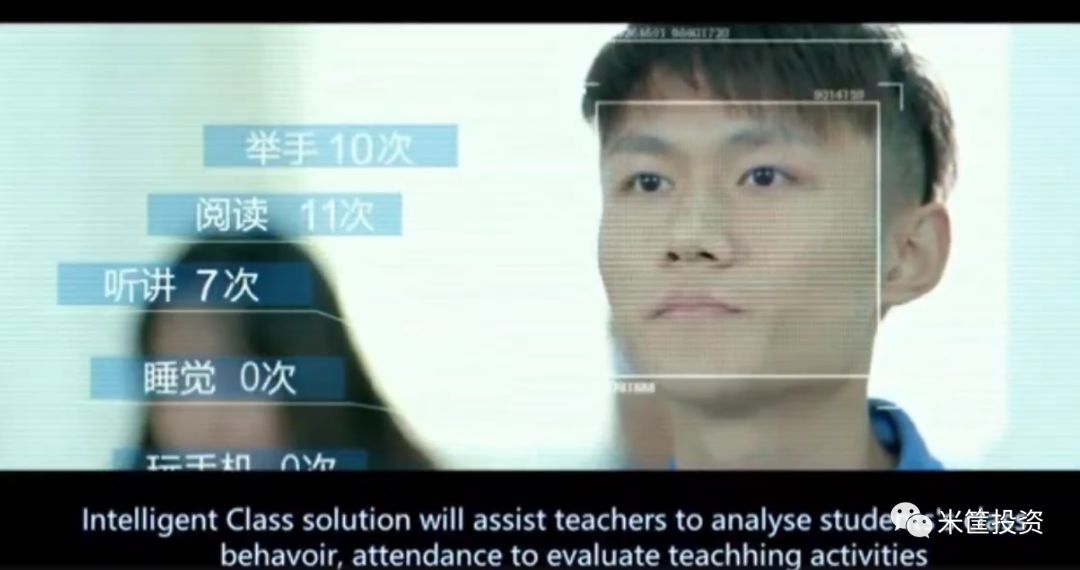

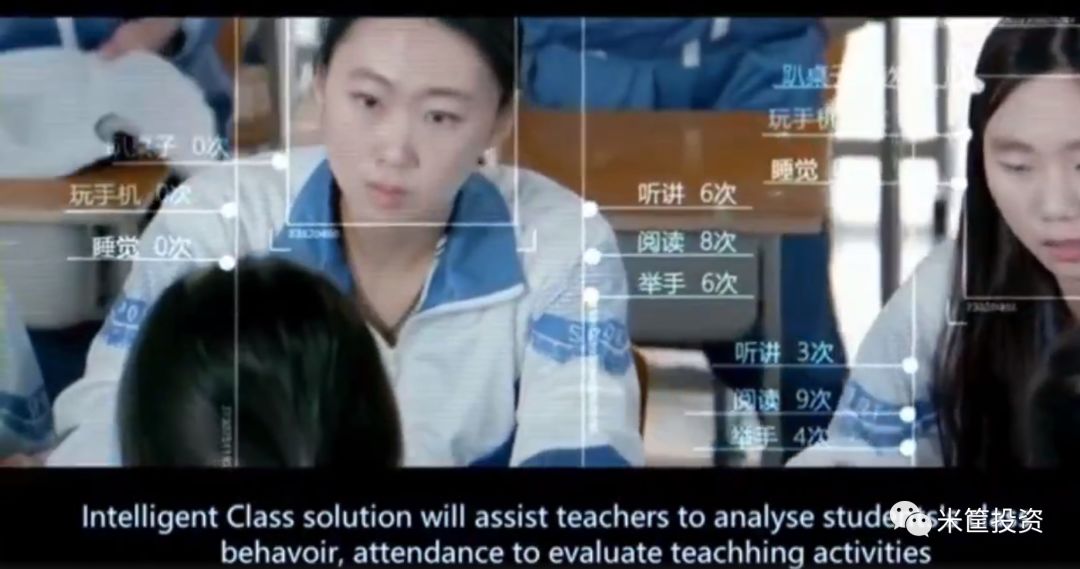

而旷视的一则宣传片,则引起了巨大争议。

在这则人脸识别运用到班级管理的短片中,摄像头不仅可以识别学生的姓名、性别等基本信息,还能统计听讲、举手、睡觉、玩手机等行为的次数,以判断学生学习的认真程度。

甚至还能通过表情来识别学生情绪,以判断他们对课程的喜好程度,数据非常精细化。

图片一出,便引起网友的强烈反对。

太侵犯隐私了!

活脱脱的1984……

这是学校还是监狱啊?

人工智能,科学养猪……

乔英子表示瞬间活不下去……

旷视也很快给出了回应,图片只是技术场景化概念演示,我们会坚持正当性、数据隐私保护等核心原则。

魔幻的是,这项技术在现实中早已应用。

8月底,媒体称位于南京的中国药科大学在两间教室试点安装了人脸识别系统,除了能自动识别学生的出勤情况,还能够实现对学生课堂听讲情况的全程监控。

而设备的供应商,正是旷视科技。

技术无罪?

必须承认,AI时代正在到来。语音识别、自动驾驶、机器人等技术,也在慢慢成熟。

作为其中的代表性技术,大众对人脸识别的接受度也在提升,2017上半年,中国使用过刷脸支付的网民占比18.7%。

除了日常生活中的刷脸支付、解锁等,人脸识别在闯红灯警示等维护公共秩序方面已经有了很好的应用。并且其应用领域,正在不断扩大。

9月4日,央视财经播出一则消息:

15年前,深圳尤国明夫妇的儿子小勇在菜市场走丢。2017年年底,公安机关与腾讯共同开发跨年龄人脸识别技术。通过模型跟数据比对,推测出小勇长大后的几百张照片,从而推断出相似度更高的人员名单,最终找到了尤国明夫妇的孩子。

但在草莽的AI时代,一切规则都混沌不清。人脸识别技术的推广,有着天然的障碍——人们对于隐私的保护,尤其是在这个看脸的时代,“脸”对人来说太重要了。

如何确保技术方不存储数据?

如何确保图像信息不用于其他场景?

如何确保这张“脸”的真实性?

如何确保这张脸不被他人利用?

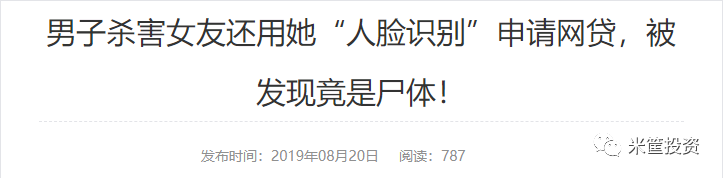

钻漏洞的例子也数不胜数。

幸亏新闻中的网贷审核员工机灵,发现脸部图像有异样并迅速报警,才得以将犯罪嫌疑人抓获。但假设审核人是机器人怎么办?审核员工不细心怎么办?

一切都要回到那个被争辩了无数次的问题,技术究竟是不是中性的?

已经出狱的王欣说,技术永远无罪,但做事的人可能会犯错。

ZAO没觉得有错,旷视更不会觉得自己有错,那些学生们更不会觉得有错,这场网友的愤怒中,到底谁错了?

或许背后的愤怒是,AI技术的引进,不再把学生当做一个人看,不再当做一个有血有肉,有情绪有感觉的人看。

在人工智能的大数据中,每个人,每个人所提供的信息,都变成了数据节点,散布在数不清的服务器中。

心理学和传播学都有个概念,叫做“霍桑效应”,说的是当人们在意识到自己正在被关注或被观察的时候,会刻意去改变一些行为或是言语表达的反应。

在摄像头下成长起来的学生,还是那个真实的自己吗?还是新一批的机器?